OpenAI annonce des mises à jour majeures: introduction de GPT-4 Turbo et plus

OpenAI a déployé une panoplie d'innovations et de mises à jour substantielles lors du tout premier événement OpenAI DevDay. Cette conférence tant attendue a été le théâtre d'annonces déterminantes qui pourraient redéfinir la manière dont nous interagissons avec la technologie au quotidien. Voici un tour d'horizon détaillé des principales annonces qui ont marqué cette journée.

Lancement de GPT-4 Turbo : L'IA linguistique

OpenAI a introduit GPT-4 Turbo, qui s'annonce comme un jalon révolutionnaire dans la course à l'intelligence artificielle la plus avancée. Ce modèle élargit considérablement la fenêtre de contexte jusqu'à 128K et se base sur des informations à jour jusqu'en avril 2023, promettant une interaction plus profonde et plus nuancée avec les utilisateurs.

C'est donc ici une amélioration profonde qui devrait encore améliorer les performances de Chat GPT. Bien sûr, nous ne sommes pas encore sur une base d'informations en "temps réel", mais force est de constater qu'ils ont grandement rattrapé le retard en termes de traitement de données, ce qui laisse présager des réponses plus cohérentes et des possibilités encore plus étendues.

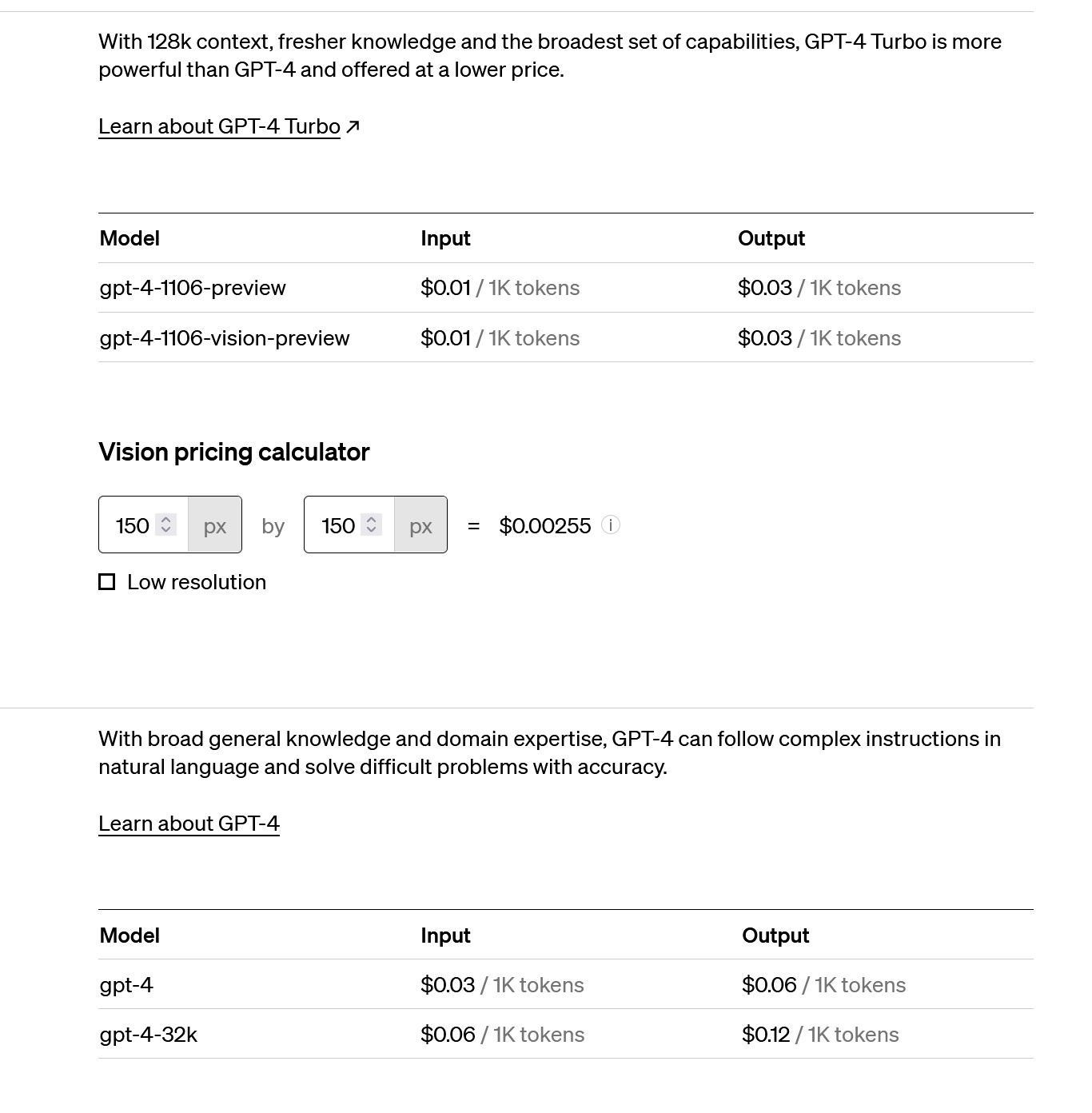

Côté tarification, GPT-4 Turbo devient beaucoup plus accessible avec une réduction significative des coûts, une initiative qui devrait ravir les développeurs et les entreprises. Les tokens d'entrée sont désormais facturés 0,01 dollar pour mille tokens, et les tokens de sortie à 0,03 dollar pour mille, soit une baisse de prix qui les rend trois fois et deux fois moins chers respectivement par rapport au tarif antérieur du GPT-4.

Les fonctionnalités de ce modèle ont également été affinées, notamment au niveau de l'appel de fonctions. Il est maintenant possible d'invoquer plusieurs fonctions dans un seul message, d'assurer un retour de fonctions valides en mode JSON et de bénéficier d'une précision améliorée pour le renvoi des bons paramètres de fonction.

Le modèle promet également des sorties plus déterministes grâce à la nouvelle fonctionnalité beta de sorties reproductibles. Les utilisateurs peuvent dès à présent accéder à GPT-4 Turbo en passant par l'identifiant gpt-4-1106-preview dans l'API, avant la sortie d'une version stable et prête pour la production plus tard dans l'année.

GPT-3.5 Turbo se met à jour

OpenAI a également mis à jour son offre avec le lancement du nouveau gpt-3.5-turbo-1106, une version améliorée qui prend en charge par défaut une fenêtre de contexte de 16 000 jetons, offrant ainsi une capacité de compréhension quatre fois plus longue que les modèles précédents. Cette extension du contexte s'accompagne d'une baisse des tarifs, rendant le modèle plus accessible à $0,001 pour mille jetons d'entrée et $0,002 pour mille jetons de sortie.

En outre, la version affinée de GPT-3.5 devient nettement plus économique : les prix des jetons d'entrée chutent de 75 % à $0,003 pour mille, tandis que ceux des jetons de sortie diminuent de 62 % à $0,006 pour mille, ce qui représente une économie substantielle pour les développeurs et entreprises utilisant ce modèle.

Le gpt-3.5-turbo-1106 s'aligne sur les avancées du GPT-4 Turbo, notamment en ce qui concerne l'amélioration de l'appel de fonctions et la disponibilité de sorties reproductibles, des fonctionnalités qui renforcent la cohérence et la fiabilité des interactions avec l'IA. Ces améliorations ouvrent la voie à une utilisation encore plus étendue de l'IA dans diverses applications, tout en conservant une structure de coût compétitive.

Commentaires (0)